-

CPM-Bee

CPM-Bee是一个完全开源、允许商用的百亿参数中英文基座模型,也是CPM-Live训练的第二个里程碑。它采用Transformer自回归架构(auto-regressive),在超万亿(trillion)高质量语料上进行预训练,拥有强大的基础能力。开发者和研究者可以在CPM-Bee基座模型的基础上在各类场景进行适配来以创建特定领域的应用模型。 👐 开源可商用:OpenBMB始终秉承“…

- 0

- 2

- 18

-

Chinese-LLaMA-Alpaca

本项目开源了中文LLaMA模型和指令精调的Alpaca大模型,以进一步促进大模型在中文NLP社区的开放研究。这些模型在原版LLaMA的基础上扩充了中文词表并使用了中文数据进行二次预训练,进一步提升了中文基础语义理解能力。同时,中文Alpaca模型进一步使用了中文指令数据进行精调,显着提升了模型对指令的理解和执行能力。 技术报告(V2):[Cui, Yang, and Yao] Eff…

- 0

- 2

- 46

-

OpenChineseLLaMA

本项目为基于 LLaMA-7B 经过 中文数据集增量预训练 产生的 中文大语言模型基座。 特点 - 本项目为通过增强预训练(Further-Pretrain)获得的中文预训练模型,提供 huggingface 版本权重 - 对比原版 LLaMA,本模型在中文理解能力和生成能力方面均获得较大提升,在众多下游任务中均取得了突出的成绩,详见 评测&nbs…

- 0

- 2

- 23

-

Fengshenbang-LM

封神榜科技成果 > Fengshenbang 1.0: 封神榜开源计划1.0中英双语总论文,旨在成为中文认知智能的基础设施。 BioBART: 由清华大学和IDEA研究院一起提供的生物医疗领域的生成语言模型。( BioNLP 2022) > UniMC: 针对zero-shot场景下基于标签数据集的统一模型。( EMNLP 2022) >&…

- 0

- 2

- 21

-

Linly

本项目向社区提供 中文对话模型 Linly-ChatFlow 、中文基础模型 Chinese-LLaMA (1-2)、Chinese-Falcon 及其训练数据。 模型基于 TencentPretrain 预训练框架全参数训练(Full-tuning)。 中文基础模型以 LLaMA 和 Falcon 为底座,使用中文和中英平行语料进行增量预训练,将其在英文上的语言能力…

- 0

- 2

- 39

-

BayLing

BayLing(百临,bǎi líng)是一种具有高级语言对齐功能的指令跟踪大型语言模型,在英汉生成、指令跟踪和多轮交互方面表现出卓越的能力。 BayLing可以轻松部署在拥有16GB内存的消费级GPU上,协助用户完成翻译、写作、创作、建议等任务...... 如果BayLing对你有帮助,欢迎star回购🌟 👇了解有关Bayling的更多信息: 💬演示:欢迎申请Bayling在线演示…

- 0

- 2

- 42

-

网易免费远程工具技术测试开启

目前主流的远程桌面软件(Todesk、向日葵、Teamviewer 等)基本都是免费+付费的模式,对于经常用远程桌面的用户来说免费版限制太多体验很不好。今天分享网易很早前推出的「UU远程」远程桌面工具,完全免费无功能限制,并且突破设备限制,可以远程控制不同设备。 UU远程介绍 这款「UU远程」提供了 Windows、macOS、安卓、iOS 客户端,通过手机号码注册登录即可使用。 点击远程协助,输…

- 0

- 1

- 39

-

[正式版] 谷歌浏览器 Chrome v128.0.6613.138

谷歌浏览器提供快速且安全的网络访问体验,支持各种扩展程序、更换主题、支持记录密码以及数据填充等诸多功能。 Chrome v128.0.6613.138版本开启谷歌新推出的智能镜头!

- 0

- 1

- 16

-

[李跳跳]好用的李跳跳又回来了

虽然李跳跳现在还能正常运行,但由于一些APP总是隔三差五的更新,导致之前的那些规则很多都失效了,所以今天阿噜噜就给大家分享一下,2024年最新可用的规则总共有2,964条规则,虽然看起来密密麻麻,但导入它们实际上非常简单。 第一步 下载一个噜噜提供的安装包和规则,下载好之后,打开规则文件。如果你打开规则是小说界面的话,不要慌点击右上角三个点,选择用其他打开方式,点击用HTML查看即可,或者你也可以…

- 0

- 1

- 131

-

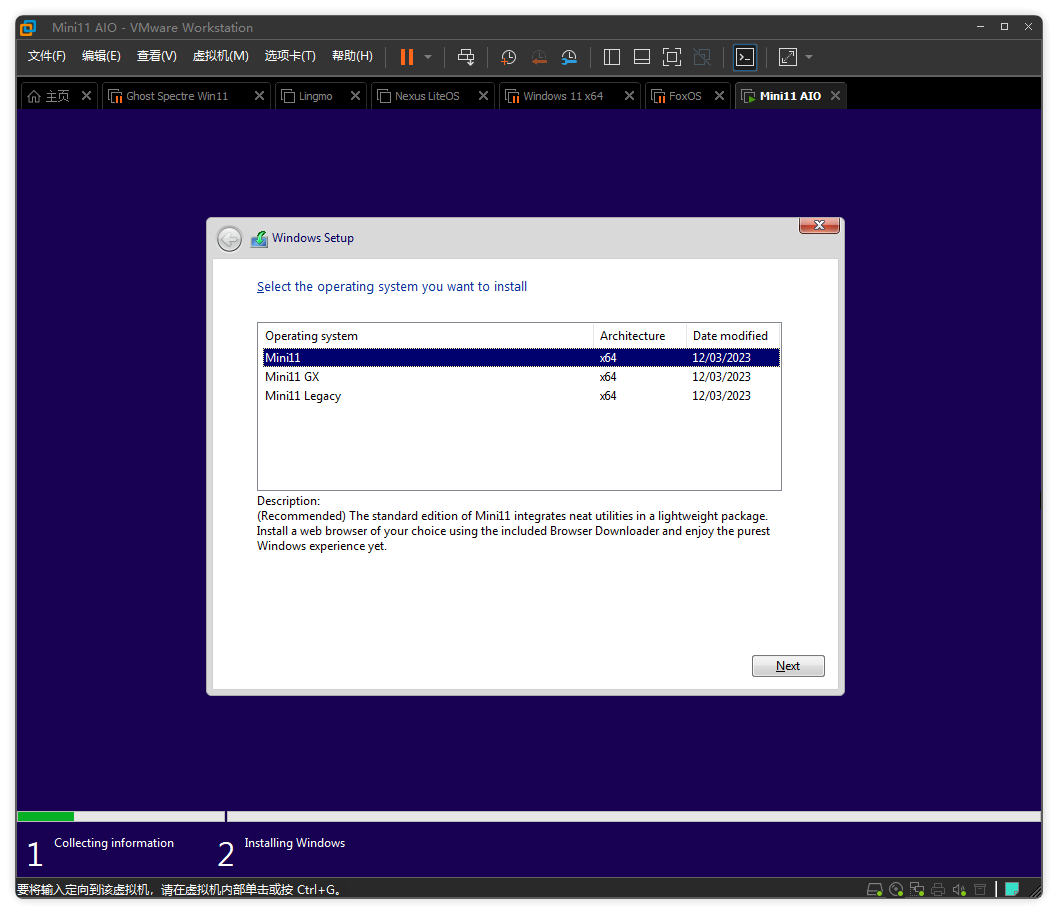

【MiniWindows】适合低配置电脑的 “迷你版” Windows 系统

之前给大家分享过不少 Windows 精简版系统了,例如:AtlasOS、ReviOS、Ghost Spectre、Tiny10 等等。 而今天分享的这个「MiniWindows」系统,提供了多个精简优化版本给用户选择,并且号称支持在奔腾 4 CPU / AMD Sempron 64 以后的电脑上安装运行,专为旧硬件打造。 MiniWindows 目前「MiniWindows」团队提供了 Mini…

- 0

- 1

- 802

-

BELLE

📝 项目主要内容 🚀 训练代码 详见 BELLE/train ,尽可能简化的一个训练代码实现,集成了Deepspeed-Chat,支持finetune,lora,并提供了相关的docker 📊 数据开放 详见 BELLE/data/1.5M ,参考 Stanford Alpaca 生成的中文数据集 1M + …

- 0

- 1

- 65

-

Panda

欢迎来到我们的海外中文大语言模型开源项目 – Panda!Panda项目于2023年5月启动,旨在大模型时代帮助整个社区探索大模型的整个技术栈。近期,我们对Panda项目进行了升级。目前Panda项目分为三个子项目:1. PandaLLM 2. PandaLLMOps 3. PandaCommunity。以下是每个子项目的具体介绍: PandaLLM 开源大模型。Panda系列开源大模…

- 0

- 1

- 13

-

LMFlow

一个可扩展、方便和高效的工具箱,用于微调大型机器学习模型。我们的目标是开发一套用户友好、快速可靠,并对整个社区开放的全流程微调代码库。 官网 https://github.com/OptimalScale/LMFlow

- 0

- 1

- 13

-

ChatYuan

ChatYuan-large-v2是一个支持中英双语的功能型对话语言大模型。ChatYuan-large-v2使用了和 v1版本相同的技术方案,在微调数据、人类反馈强化学习、思维链等方面进行了优化。 ChatYuan-large-v2是ChatYuan系列中以轻量化实现高质量效果的模型之一,用户可以在消费级显卡、 PC甚至手机上进行推理(INT4 最低只需 400M )。 在线Demo(Huggi…

- 0

- 1

- 17

-

ChatRWKV

ChatRWKV 类似于 ChatGPT,但由 RWKV(100% RNN)语言模型提供支持,并且是开源的。 ChatRWKV 类似于 ChatGPT,但由我的 RWKV(100% RNN)语言模型提供支持,这是唯一的 RNN (截至目前)它可以在质量和缩放方面与 Transformer 相匹配,同时速度更快并节省 VRAM。由 Stability EleutherAI 赞助的培训:) Raven…

- 0

- 1

- 13

-

ChatGLM-6B

ChatGLM-6B 是一个开源的、支持中英双语的对话语言模型,基于General Language Model (GLM) 架构,具有62 亿参数。结合模型量化技术,用户可以在消费级的显卡上进行本地部署(INT4 量化级别下最低只需6GB 显存)。 ChatGLM-6B 使用了和ChatGPT 相似的技术,针对中文问答和对话进行了优化。经过约1T 标识符的中英双语训练,辅以监督微调、反馈自助、人…

- 0

- 1

- 16

-

ChatGLM2-6B

ChatGLM 2-6B 是开源中英双语对话模型 ChatGLM-6B 的第二代版本,在保留了初代模型对话流畅、部署门槛较低等众多优秀特性的基础之上,ChatGLM 2-6B 引入了如下新特性: 更强大的性能:基于 ChatGLM 初代模型的开发经验,我们全面升级了 ChatGLM2-6B 的基座模型。ChatGLM2-6B 使用了 GLM&nbs…

- 0

- 1

- 21

-

Chinese-LlaMA2

就在不久前,Meta最新开源了Llama 2模型,完全可商用,看来Meta势必要与OpenAI (ClosedAI) 硬刚到底。虽然Llama 2对原版的LlaMA模型做了升级,但是其仍然对中文没有太好的支持,需要在中文上做定制化。所以我们决定在次开展Llama 2的中文汉化工作: 🚀 Chinese-LlaMA2-chat-sft:对Llama-2直接进行有监督微调, 采用开源指令微调…

- 0

- 1

- 27

-

Llama2-Chinese

欢迎来到Llama2中文社区!我们是一个专注于Llama2模型在中文方面的优化和上层建设的高级技术社区。 基于大规模中文数据,从预训练开始对Llama2模型进行中文能力的持续迭代升级。 我们热忱欢迎对大模型LLM充满热情的开发者和研究者加入我们的行列。 为什么选择Llama2中文社区? 🚀 高级工程师团队支持:社区有一批专注为大家服务的NLP高级工程师,我们有着强大的技术支持和…

- 0

- 1

- 38

-

BiLLa

BiLLa是开源的推理能力增强的中英双语LLaMA模型。模型的主要特性有: 较大提升LLaMA的中文理解能力,并尽可能减少对原始LLaMA英文能力的损伤; 训练过程增加较多的任务型数据,利用ChatGPT生成解析,强化模型理解任务求解逻辑; 全量参数更新,追求更好的生成效果。 因个人精力有限,我未能将BiLLa与当前主流的开源大模型进行充分的对比评测。以下是经过有限的评测分析得出的结…

- 0

- 1

- 12

![[正式版] 谷歌浏览器 Chrome v128.0.6613.138](https://arlulu.oss-accelerate.aliyuncs.com/2024/06/20240628045731691.jpg?x-oss-process=image/resize,m_fill,h_470,w_626/sharpen,120)

![[李跳跳]好用的李跳跳又回来了](https://arlulu.oss-accelerate.aliyuncs.com/2024/04/20240415070835791.jpg?x-oss-process=image/resize,m_fill,h_470,w_626/sharpen,120)